«Zurich Vision Lab» und mehr: Woran Apple in der Schweiz forscht und entwickelt

Computer Vision, ML, AI, Siri, Apple Maps, autonome Systeme, Firmware und mehr

Verschiedene Grössen aus der IT- und Unterhaltungs-Branche wie Google oder Disney forschen und entwicklen seit Jahren in Zürich. Das ist allgemein bekannt. Was ungleich weniger bekannt ist: Auch Apple hat sich in der Zwingli-Stadt ausgebreitet. Typisch für Apple hüllt sich der Mac-Hersteller jedoch in grösstes Schweigen über seine Aktivitäten in der Schweiz. Es gab zwar bereits Hinweise und Vermutungen, aber genauere Details darüber, an was Apple hierzulande arbeitet und welche Produkte massgeblich mit in der Schweiz entwickelt werden, waren bisher nicht bekannt. Bis jetzt. In einer aufwändigen Recherche sind wir genau diesen Fragen nachgegangen. Über vier Jahre lang haben wir nachgeforscht. Wir haben akribisch Apples Rekrutierungs-Bemühungen in der Schweiz verfolgt und mit involvierten Personen gesprochen. Vieles bleibt zwar weiterhin unklar, aber zu einigen Punkten können wir Licht ins Dunkle bringen. Apple arbeitet in Zürich an einer Vielzahl an Themen, und es ist anzunehmen, dass auch im heiss-spekulierten AR-/VR-/MR-/XR-Headset von Apple viel Schweiz stecken dürfte.

Inhaltsverzeichnis

Apple und die Schweiz: Eine Lovestory

Das «Zurich IT-Valley»

Von FaceShift zu einem Zürcher-Apple-Labor

Das «Zurich Vision Lab»

Und vieles mehr …

Zürich ist ein wichtiger Apple-Standort

Wichtiges

Apple wollte zu unseren Recherchen keinen offiziellen Kommentar abgeben. Das Unternehmen hat weder die im vorliegenden Artikel beschriebenen Teams und Aktivitäten von Apple in Zürich bestätigt noch bestritten.

Die in diesem Artikel dargelegten Annahmen basieren auf den Ergebnissen unserer umfangreichen Recherchen, die grösstenteils auf öffentlichen Quellen und Gesprächen mit involvierten Personen beruhen (vgl. «Quellen»).

Aufgrund der zeitlichen Länge der Recherche ergab sich eine Schwierigkeit hinsichtlich der Aktualität des Artikels. Wir können nicht ausschliessen, dass einige der im Artikel genannten Themenfelder mittlerweile nicht mehr in Zürich angesiedelt sind. Es ist möglich, dass Apple bestimmte Bereiche inzwischen an einen anderen Standort verlagert hat. Ebenso ist nicht bei allen Themenfeldern vollständig klar, ob sie tatsächlich in Zürich angesiedelt sind oder ob Apple nur daran interessiert war, Talente aus der Schweiz zu rekrutieren

Apple und die Schweiz: Eine Lovestory

Die Schweiz ist in der Apple-Community mitunter dafür bekannt, dass Apple hierzulande schon immer ein überdurchschnittlich hoher Markanteil hatte. Dieser liegt deutlich über jenem der Nachbarländer und oft sogar hatte Apple in der Schweiz mit den grössten Markanteil weltweit. Das war bereits vor dem iPhone der Fall, als Apple noch die «Mac-Company» war.

Für die einen liegt dies darin begründet, dass Schweizer ein starkes Qualitätsbewusstsein haben sollen, technikvernarrt seien, immer das Neueste haben möchten und eine hohe Kaufkraft aufweisen. Auch wurde den Schweizern schon attestiert, ein Volk von «Early-Adoptern» zu sein. Das zeigte sich unter anderem exemplarisch, als Apple 2007 das iPhone lancierte. Schon bevor Apples Smartphone ein Jahr später offiziell in der Schweiz erhältlich war, sollen hier bereits geschätzte 100’000 iPhone aktiv im Umlauf gewesen sein.

Auch hat es sicherlich nicht geschadet, dass der Mac-Hersteller frühzeitig in der Schweiz aktiv war. Kurz nachdem Apple mit dem «Apple II» in den USA den Heim-Computer-Markt mitbegründet hatte und erste grosse Erfolge feierte, fanden sich findige Unternehmer, die diese Revolution auch in die Schweiz brachten. Bald schon folgte Apple ganz offiziell und ist seitdem hierzulande fest verankert. Zuerst ging es nur um den Vertrieb durch Partner aus dem Fach- und Detailhandel. Später kamen eigene Vertriebskanäle hinzu. In der zweiten Hälfte der 2000er-Jahre war der Genfer Apple Store beispielsweise der erste Verkaufsladen von Apple in Kontinentaleuropa. Und seit einigen Jahren betreibt Apple auch Forschungs- und Entwicklungstätigkeiten in Zürich.

Mehr solche Stories möglich machen?

Unterstütze unser Tun mit dem Abschluss eines freiwilligen Gönner-Abos 🚀 oder mit einer Einzel-Spende.

macprime unterstützen

Das «Zurich IT-Valley»

Zürich ist ein perfekter Ort für Tech-Giganten. Viele grosse IT-Unternehmen wie Google, IBM, Disney, Facebook oder Microsoft forschen in oder um die Stadt an der Limmat. Google etwa hat in Zürich bekanntermassen die grösste Niederlassung ausserhalb seines Heimmarktes USA, ebenso Disney mit «Disney Research Zurich». IBM betreibt hier seit vielen Jahren Forschung, unter anderem im Bereich wegweisender Quanten- und Nanotechnologie.

Zürich ist aus verschiedenen Gründen interessant für diese globalen ICT-Riesen. Der Stadt wird eine exzellente Standortqualität zugeschrieben – die Infrastruktur ist hervorragend, die Arbeitswege sind kurz, der gut angebundene Flughafen Kloten befindet sich in unmittelbarer Nähe und die Lebensqualität gehört zu den weltweit höchsten. Ausschlaggebend dürfte aber vor allem auch sein, dass die ETH Zürich hier beheimatet ist. Die Eidgenössische Technische Hochschule Zürich wird regelmässig von internationalen Rankings als eine der besten Universitäten weltweit und als führende Universität in Kontinentaleuropa bewertet.

Der hoch qualifizierte Nachwuchs lockt die grossen Unternehmen der Tech-Branche an, es entstehen innovative Start-ups, und all das zieht wiederum weitere Talente nach Zürich. Dies schafft eine positive Aufwärtsspirale für die Metropole im Limmattal.

Apples Forschungskapitel in Zürich begann vor etwa 10 Jahren.

Von FaceShift zu einem Zürcher-Apple-Labor

Ende 2015 wurde bekannt, dass Apple im Sommer desselben Jahres das Schweizer Motion-Capture-Startup «FaceShift» übernommen hat. Das Spin-off der Westschweizer Schwesterinstitution der ETH, der «École polytechnique fédérale de Lausanne» (EPFL), wurde 2013 in Zürich gegründet und forschte im Zürcher Technopark im Bereich Echtzeit-Motion-Capture.

Mit den damals vom Unternehmen entwickelten Technologien war es unter anderem möglich, Gesichtszüge am Computer realitätsnah zu rekonstruieren. Wie wir damals berichteten: «Die Errungenschaften der Zürcher können beispielsweise in Spielen dazu verwendet werden, die Gesichter der Spiel-Charaktere auf die tatsächlichen Gesichtsausdrücke der Spieler anzupassen. In Filmen können die Technologien dafür genutzt werden, dass am Computer erstellte Figuren menschen-ähnlichere Gesichtsausdrücke erhalten.» Die FaceShift-Technologien kamen zum Beispiel im Film «Star Wars: The Force Awakens» aus dem Jahr 2015 zum Einsatz. FaceShift betrieb auch Forschung im Bereich fortschrittlicher Gesichtserkennungs-Technologien.

Zwei Jahre nach der Übernahme wurde deutlich, warum Apple so grosses Interesse an dem Unternehmen aus Zürich hatte: Die «TrueDepth»-Kamera auf der Vorderseite des im Jahr 2017 eingeführten iPhone X konnte nicht nur für die Authentifizierung mittels «Face ID» verwendet werden, sondern auch die Gesichtsmerkmale der Benutzer anhand eines 3D-Modells auf verschiedene Emoji-Charaktere projizieren. Diese «Animoji» genannte Technologie erinnert stark an die Errungenschaften aus Zürich. Dies wurde ein Jahr später auch durch Apple-Patente bestätigt: Die Animojis (später erweitert durch «Memojis») stammen auch aus Zürich.

Um diese Zeit herum wurde zudem berichtet, dass mehrere Doktoranden und Postdocs der ETH zu einem «Labor von Apple in der Schweiz» gewechselt haben sollen. Die Rede war damals vornehmlich von Spezialisten aus dem Bereich «Computer Vision» und «Robotik», die an «visueller Navigation» forschten. Es wurde auch das Gebiet des «autonomen Fahrens» genannt.

Wie wir heute wissen, war Apple zu dieser Zeit bereits aktiv dabei gewesen, ein eigenes «Computer Vision Lab» in Zürich aufzubauen.

Apple war in diesen Jahren auch mit eigenem Stand an der «Polymesse» vertreten. Bei dieser mehrtägigen Absolventenmesse der ETH Zürich haben Studierende und Doktoranden die Möglichkeit, mit über 100 nationalen und internationalen Unternehmen in Kontakt zu treten. Der Event wird auch als «Kontakt-Drehscheibe» für Absolvierende und Firmen bezeichnet.

Studierende, die den Apple-Stand an der Polymesse besucht hatten, erinnerten sich im Gespräch mit uns, dass der Mac-Hersteller keine detaillierten Informationen darüber preisgeben wollte, an welchen Projekten genau die iPhone-Company hierzulande arbeitet. Basierend auf den Aussagen der Apple-Vertreter soll aber klar gewesen sein, dass es um den damals heiss spekulierten «Apple Car» gehe. Es wurde über Systeme des autonomen Fahrens, Navigation und weitere Themen der Computer Vision gesprochen.

Auf Hinweise zum vermeintlichen «Apple Car» und rund um das Thema «autonomes Fahren» sind wir in unseren Recherchen auf keine gestossen – wohl aber, dass Apple in Zürich mit an «autonomen Systemen» forscht.

Unter «autonomen Systemen» sind aber nicht nur selbstfahrende Autos (und damit ein mögliches Apple-Auto) gemeint, sondern auch eine Vielzahl andere «intelligenter» Dinge, wie autonome Lagerhäuser, Roboter, Drohnen und «Smart Cities». Auch das Internet kann als autonomes System betrachtet werden – es ist dezentral aufgebaut, es ist erweiterbar und es kann sich bei Ausfällen anpassen. Die als «vierte industrielle Revolution» bezeichneten «autonomen Systeme» spielen eine grundlegende Rolle beim maschinellen Lernen, beim «Deep Learning», bei der künstlichen Intelligenz und für das gesamte Feld der «Computer Vision».

Diesen hochtechnischen Bereichen widmet sich Apples «Zurich Vision Lab». Unsere Recherchen deuten darauf hin, dass Apple in der Limmat-Stadt mit wahrscheinlich mehreren Forschungseinrichtungen und verschiedenen Teams auch andere Themen bearbeitet.

Das «Zurich Vision Lab»

Die grossen Themen-Felder, denen sich Apple in Zürich widmet, sind Computer Vision, Machine Learning (maschinelles Lernen; ML), Robotik und Artificial Intelligence (künstliche Intelligenz; AI resp. KI). Das Zürcher Labor wird insbesondere als «Schnittstelle zwischen modernen ML, Robotik und Datenwissenschaft» verstanden, um künstliche Intelligenzen voranzutreiben, welche die «nächste Generation von Apple-Produkten» antreiben werden.

Das «Zurich Vision Lab» ist ein Apple-Zentrum für «Machine Learning and Computer Vision Research and Development». Dieses Labor macht einen Grossteil von Apples hiesigen Forschungs- und Entwicklungs-Aktivitäten aus.

Mit dazu gehören verschiedene Teams aus dem Bereich «System Intelligent and Machine Learning», kurz «SIML». Beispielsweise sind auch Ableger von Apples «Human and Object Understanding»-Gruppe, kurz «HOUr», oder das «Scene Understanding»-Team («SUN») in Zürich.

Über allem ist auch Apples ominöse «Special Projects Group» in Zürich allgegenwärtig. Diesem Gebilde werden gemeinhin allerlei Projekte zugeschrieben, die ausserhalb der klassischen Produkte-Familien von Apple liegen. Dazu gehören auch künftige Produkte wie das Apple-Auto oder das spekulierte Headset von Apple, die in dieser Abteilung entwickelt werden sollen. Viele von Apples Forschungsanstrengungen sind ebenfalls in diesem Bereich angesiedelt – einschliesslich Arbeiten an autonomen Systemen.

Ein weiteres Team in Zürich widmet sich speziell der «Förderung von Inklusion und Fairness bei KI-geschützten Funktionen». Dieses Team wurde vor etwa einem Jahr in der Limmat-Stadt aufgebaut und arbeitet eng mit Teams in Kalifornien zu diesen Themen zusammen.

In Zürich verbessert Apple nicht nur bestehende Technologien, sondern entwickelt auch «völlig neue Ansätze, wie mit Geräten interagiert wird». Die Teams sind nicht nur «Ausführende» von Anweisungen aus der Zentrale in Cupertino, sondern spielen eine federführende Rolle in der Forschung und Entwicklung und sind auch an vorderster Front bei strategischen Entscheidungen des Unternehmens beteiligt.

Das «Zurich Vision Lab» von Apple wird von Brian Amberg geleitet, einem ehemaligen Gründungsmitglied von FaceShift. Von den anderen drei FaceShift-Gründern arbeitet heute keiner mehr für den Mac-Hersteller. Thibaut Weise war nach der Übernahme durch Apple im August 2015 noch bis im Januar 2020 beim Mac-Hersteller in Zürich tätig und ist heute Chef von «Epic Games Germany». Sofien Bouaziz blieb bis April 2018 bei Apple in Zürich und wechselte dann ins Silicon Valley, wo er über Google zu Facebook bzw. Meta kam. Dort ist er heute Forschungs- und Entwicklungs-Chef der «Meta Reality Labs». Mark Pauly verliess die Gruppe mit der Übernahme durch Apple und wurde Professor an der EPFL. Er gründete zudem eine neue Firma namens «Rayform».

Apples «Zurich Vision Lab» beschäftigt sich unter anderem mit Echtzeit-Computer-Vision und -Bildverarbeitung. Es ist die Sprache von «Video- und Bild-Analyse der nächsten Generation». Dabei wird erforscht, wie moderne maschinelle Lernverfahren mit dreidimensionalem (3D) geometrischem Wissen aus der Computer Vision kombiniert werden können. Eine der bekanntesten Entwicklungen aus Zürich ist die Technologie für «Animoji» und später auch «Memoji». Diese Zürcher Entwicklung steht über Apples Augmented-Reality-Framework «ARKit» auch Drittanbietern zur Verfügung.

Das Zürcher Labor schmückt sich damit, dass es «Facial Motion Capture» – also die digitale Erfassung und Aufzeichnung von Gesichtsbewegungen sowie die detaillierte 3D-Modellierung von Gesichtern – für die breite Öffentlichkeit zugänglich gemacht hat.

Im Labor wird auch an «neuen fotografischen Erfahrungen» geforscht. Zu den von diesen Teams mit-bearbeiteten Projekten gehörten neben der Kalibrierung optischer Verzerrungen, Bildstabilisierungen und automatischen Bild-Bearbeitungen auch die Stereo-Bildgebung respektive Multi-Kamera-Kalibrierung. Ein prominentes Produkt letzteres ist der «Porträtmodus» der iPhone-Kamera.

Ein weiteres Thema dieser Teams ist die Entwicklung leistungsstarker «Simulations-Frameworks der nächsten Generation» – Apple im Wortlaut: «einschliesslich AR-/VR-Funktionen».

Unseren Erkenntnissen zufolge stammt auch die Funktion «FaceTime Eye Contact (Augenkontakt)» mit aus Zürich. Diese Funktion sorgt in Apples Videokonferenz-Funktion «FaceTime» dafür, dass die Teilnehmenden einander in die Augen schauen, obwohl sie dies tatsächlich nicht direkt tun. Mithilfe ausgefeilter Algorithmen werden die Pupillen der gezeigten Person so verändert, dass sie augenscheinlich aussieht, als ob sie direkt in die Kamera schauen, auch wenn der eigene Blick beim Facetimen eher auf die Anzeige des Gegenübers auf dem Bildschirm unter oder neben der Kamera gerichtet ist und nicht auf die Kamera selbst.

Auch ein grosses Thema in Zürich ist die Erkennung und Segmentierung von visuellen Daten – also unter anderem die Erkennung von Objekten innerhalb eines Bildes. Apple spricht hier direkt auch von «visuellem Suchen».

In Zürich werden Technologien mitentwickelt, die sicherstellen, dass in Apples Fotos- und Kamera-Apps sowie in Frameworks wie Vision und Core ML das auf den Fotos und Videos Abgebildete erkannt und analysiert werden kann. Diese Entwicklungen finden in vielfältigen Anwendungen Verwendung, darunter die Erkennung von Personen in Bildern oder die «Live Text»-Funktion, bei der Texte in Fotos und Videos oder über die Kamera erkannt und weiterverwendet werden können.

Auch «Visual Lookup», jene Funktion in der Fotos-App, bei der über eine Schaltfläche zusätzliche Informationen über das in einem Foto Abgebildete eingeblendet werden können, stammt mit aus der Zwingli-Stadt. Ebenso wurden die Technologien hinter den automatisch generierten «Memories (Rückblicke)» oder dem «Intelligent Autocrop (Intelligentes Zuschneiden)» beim Bearbeiten von Medien sowie die intelligenten Such-Fähigkeiten der Fotos-App mit in Zürich entwickelt.

Auch an diversen weiteren Echtzeit-Berechnungen und -Segmentierungen von Medien arbeitet Apple in Zürich – darunter «Visual Captioning», wozu wahrscheinlich beispielsweise auch die Bedienungshilfe «Door Detection (Tür-Erkennung)» gehören dürfte.

Apple forscht hier auch an Technologien zur Erkennung von Handschrift und freiem Zeichnen – eine «interaktive Art, wie maschinelles Lernen mit Computer-Vision-Technologien kombiniert wird», so Apple. Die Scribble-Funktion der Apple Watch und des iPad, die automatische Erkennung und Generierung von Formen beim Zeichnen sowie neue Funktionen für den «Apple Pencil» haben ebenfalls mit ihren Ursprung in Zürich.

Und vieles mehr …

Mindestens ein Team in Zürich konzentriert sich auf «autonome Technologien im Umfeld der Robotik». Hier wird speziell an maschinellem Lernen mit Schwerpunkt auf «Deep Learning» (DL) und «Reinforcement Learning» (RL) geforscht. Der Fokus liegt auf der Entwicklung und Integration anspruchsvoller Algorithmen für komplexe autonome Robotik-Systeme.

Die Aktivitäten von Apple in Zürich gehen jedoch über diese Bereiche hinaus.

Es wird auch an Systemen für Datenverarbeitungs- und Rechendienste gearbeitet, die anderen Teams innerhalb von Apple zur Verfügung gestellt werden. Sowohl die Systeme selbst als auch ihre Web-Oberflächen werden in Zürich mitentwickelt. Es ist die Rede davon, wie mit diesen Systemen im Zusammenhang mit maschinellem Lernen riesige Datenmengen, im Umfang von vielen Petabytes, gesammelt und verarbeitet werden. Und auch davon, wie die daraus resultierenden Algorithmen aus Zürich mit trainierten Modellen in die Apple-Produkte übertragen werden.

«Hey Siri»

Weiter gibt es in Zürich verschiedene Teams aus dem Bereich «Information Intelligence». Dazu gehören auch verschiedene Teams, die an Siri arbeiten, wie «Siri Search & Knowledge», «Siri AI/ML» oder «Siri International». Es scheint, dass Apple in der Limmat-Stadt eine Vielzahl von Teams für maschinelles Lernen und künstliche Intelligenz hat – einschliesslich Mitarbeitende der «Intelligent System Experience»-Organisation, kurz «ISE».

Das Zurich Vision Lab trägt also auch zur Weiterentwicklung von Siri bei. In Zürich werden unter anderem «neue visuelle Fähigkeiten» für den digitalen Assistenten entwickelt, die «die Art und Weise, wie die Menschen mit der Welt um sie herum umgehen, verändern wird», so Apples eigener Wortlaut.

Dabei wird in der grössten Schweizer Stadt nicht nur an den eigentlichen Siri-Fähigkeiten gearbeitet, sondern auch an der Infrastruktur des digitalen Assistenten. Mit hier entsteht die Core-Software-Infrastruktur für «die nächste Generation der Siri-Funktionen zum Verstehen natürlicher Sprache». Ein besonderer Schwerpunkt wird in Zürich auf verschiedene Sprachen, Akzente und Dialekte gelegt («Siri International»). Es wird an «bahnbrechenden Technologien zum Verständnis natürlicher Sprache» gearbeitet, die dann weltweit zum Einsatz kommen. Das spiele auf Apples Vision des «mehrsprachigen, multikulturellen Siri-Assistenten» ein, sowie der zugehörigen macOS- und iOS-SDK und Suchanwendungen. In Zürich beschäftigen sich diese Teams auch mit Fragen wie «Wie funktioniert Siri mit Musik auf der Apple Watch?» oder «Wie sollen Erinnerungen auf dem HomePod funktionieren?».

Auch an Siris universeller Suchmaschine wird in Zürich mitgearbeitet. Diese ermöglicht verschiedene Funktionen in Siri selbst, in der systemweiten Suche «Spotlight», im Browser «Safari», in «Messages (Nachrichten)» oder die erwähnte Funktion «Visual Lookup (Visuelles Nachschlagen)».

Das hiesige Team bereichert das Verständnis von Siri mit «tiefem Wissen über die Welt». Dazu gehört auch die Internet-Suchmaschine von Apple, die auf den Plattformen vornehmlich via Siri und Spotlight zum Einsatz kommt. Mit aus Zürich stammen die Technologien, mit denen Apple das Internet durchforstet und indexiert, anhand deren die Linkauswahl, Aktualität und Extraktionsqualität analysiert und ein Ranking zu den Inhalten erstellt wird – mit dem Ziel, aus «Billionen von Links die besten Inhalte zu finden, die den Nutzern über die Suche angezeigt werden».

Health-AI

Ebenfalls aktiv in der Schweiz ist Apples «Health AI»-Team. Dieses Team betreibt Grundlagenforschung und möchte schwierige reale Herausforderungen mit der Entwicklung neuartiger Technologien lösen. Die Forschung soll sich auf die Gesundheit von Millionen von Menschen auf der ganzen Welt auswirken. Das Schweizer Team fokussiert sich dabei insbesondere auf AI/ML für biomedizinische Signale und Gesundheit.

AI-Text-Generierung

Ein weiteres Team in Zürich, das «Input Experience NLP Team», kümmert sich um generative Modelle für die Texterstellung. Hier wird maschinelles Lernen auf das Gebiet des Natural Language Processing (NLP), also der Verarbeitung natürlicher Sprache, angewendet. Es sind dies Offline-NLP-Modelle, die dank leistungsstarker maschineller Lernverfahren direkt auf dem Gerät angewandt werden können.

Gearbeitet wird hier an einem breiten Spektrum von Textgenerierung-Technologien, die auf den verschiedenen Apple-Plattformen zum Einsatz kommen und über das «Natural-Language»-Framework auch Dritten zur Verfügung gestellt werden.

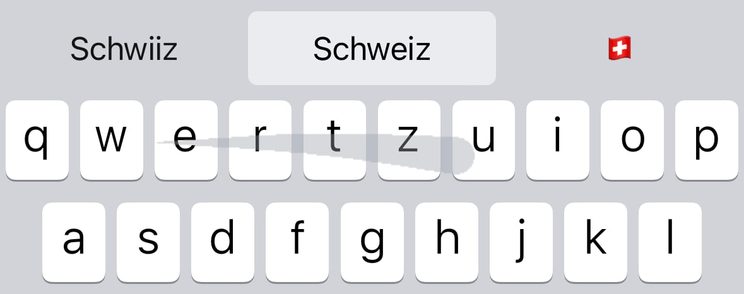

Zu den Entwicklungen gehören Funktionen wie die «Auto-Korrektur», «QuickType» (das «Predictive Typing», also «Vorausschauendes Tippen» resp. «Vorschläge» in iOS) und «QuickPath» (die Wisch-Tastatur resp. «Zum Tippen streichen»). Ebenfalls in Zürich wird an der AI-Generierung von «langen Texten, Zusammenfassungen oder Frage-Beantwortungen» gearbeitet.

Drahtlose Ladetechnik

Auch an neuen Generationen drahtloser Ladetechnologien für das iPhone, die Apple Watch, die AirPods und anderen Geräten wird in Zürich gearbeitet – zusammen mit mehreren Teams rund um den Globus.

Insbesondere die Entwicklung der Firmware solcher Systeme scheint in einem Team namens «Wireless Power Technology Team» der «Human Interface Device»-Abteilung («HID») in Zürich angesiedelt zu sein.

Apple Maps

Von Zürich aus wird auch an Apples hauseigener Karten-Technologie mitgearbeitet: Das in Zürich beheimatete «Traffic Team» von Apple Maps entwickelt Funktionen wie die Routenplanung und die Anzeige der erwarteten Ankunftszeit (ETA) in der Karten-App. Das Team arbeitet auch an der Anzeige von Verkaufsaufkommen sowie Informationen zu Geschwindigkeitsbegrenzungen und Verkehrsereignissen wie Unfällen, Gefahrenstellen, Geschwindigkeitskontrollen/Radar oder Strassenarbeiten.

Und und und …

Im «Apple Media Products»-Team wird von Zürich aus an der Sicherheit der Infrastruktur von App Store, Apple Music und Co. gearbeitet.

Apples «CoreMotion» wird ebenfalls mit in der Zwingli-Stadt weiterentwickelt. Dieses Framework ermöglicht die Nutzung verschiedener Daten von umgebungsbezogenen Sensoren – einschliesslich des im iPhone und anderen Geräten integrierten Beschleunigungsmessers, des Gyroskops und des Schrittzählers.

Interessanterweise suchte Apple in Zürich auch schon nach neuen Mitgliedern für das «Camera System Architecture Team». Für dieses suchte das Unternehmen nach Personen, die zukünftige Anforderungen an die Kamera-Hardware von Apple-Produkten bestimmen würden («Erarbeitung von Vorschlägen für künftige Apple-Imaging-Lösungen»). Inzwischen ist bekannt, dass Apple mit besonderem Fokus in der «Camera Hardware Group», die sich unter anderem in München und Grenoble befindet, an neuen Kamera-Systemen forscht und entwickelt. Es ist also möglich, dass Apple die Nähe zur Schweiz auch nutzt, um neue Talente für Standorte im benachbarten Ausland zu rekrutieren.

Wie eingangs erwähnt, könnte das, was für die letztgenannten Rollen gilt, auch für andere in diesem Artikel erwähnte Teams gelten. Es ist nicht ausgeschlossen, dass Apple zwar versucht, einige seiner Rekrutierungen in der Schweiz durchzuführen, diese Stellen aber letztendlich im nahen oder fernen Ausland angesiedelt sind. Es ist auch möglich, dass bestimmte erwähnte Teams mittlerweile an andere Standorte verlagert wurden.

Viele Forschungs- und Entwicklungsaktivitäten der genannten Zürcher Teams werden eng mit anderen Apple-Standorten weltweit koordiniert, darunter natürlich auch mit dem Hauptsitz von Apple im «Silicon Valley» in Kalifornien.

Praktika, «Apple Scholar» und «Residency Program»

Übrigens bietet Apple in Zürich auch kontinuierlich Praktika in verschiedenen Disziplinen an.

Apple finanziert ausserdem seit drei Jahren herausragende Doktoranden verschiedener Hochschulen und Universitäten in den Bereichen künstlicher Intelligenz und maschinellem Lernen. Drei der streng limitierten Plätze wurden bisher an Doktoranden der ETH Zürich vergeben. Das Stipendium, bekannt als «Apple Scholar», beinhaltet unter anderem ein Mentorat (teilweise durch den Lab-Chef Amberg) sowie ein Praktikum im Unternehmen, bei dem an grossen Forschungsprojekten mitgearbeitet werden kann.

Darüber hinaus gibt es das «Residency Program», ein einjähriges Programm, bei dem Experten aus verschiedenen Bereichen ihr Fachwissen in die Entwicklung neuer Produkte und «Experiences» einbringen können. In Zürich wird das Programm speziell im Bereich des «maschinellen Lernens und der KI» sowie in Apples «Health AI»-Team angeboten.

Zürich ist ein wichtiger Apple-Standort

Apple ist in Zürich stark präsent. Hier wird nicht nur an Animojis gearbeitet, sondern an einer Vielzahl von Themen. Apple forscht in der Schweiz an zentralen Technologien und Komponenten seiner Produkte.

Auch im seit Monaten heiss-spekulierten AR-/VR-/MR-/XR-Headset von Apple wird unseren Erkenntnissen zufolge wahrscheinlich sehr viel Schweiz stecken. Das Gebiet der «Computer Vision» ist für ein Headset von entscheidender Bedeutung, und das Forschungslabor von Apple zu diesem Thema spielt sicherlich eine zentrale Rolle.

Viele Details darüber, was genau Apple in Zürich macht, sind jedoch leider immer noch unklar. Zum Beispiel ist nicht bekannt, an welchen genauen Orten in Zürich Apple seine Forschungs- und Entwicklungsstandorte betreibt (unsere Recherchen im Kreis 1, 6, 7 und 10 über das Industriequartier bis ins Seefeld haben sich mehrmals als erfolglos erwiesen), wie viele Forschende und Entwickelnde das Unternehmen in der Schweiz beschäftigt und ob alle von uns genannten Bereiche und Teams tatsächlich immer noch in Zürich ansässig sind.

Es bleibt spannend: wie sich Apples Forschungs- und Entwicklungs-Aktivitäten in Zürich weiterentwickeln; welche weiteren bahnbrechenden Technologien hierzulande mit-entstehen; und in welchen zukünftigen Apple-Produkten sie dereinst Anwendung finden werden.

Genauso aufregend für uns ist die Frage, wie lange es dauern wird, bis Apple sein «Zurich Vision Lab» und seine sonstigen Anstrengungen in der Schweiz richtig öffentlich bekannt macht.

Gefiel dir diese Story?

Wir benötigen deine Unterstützung! Unterstütze macprime mit einem freiwilligen Gönner-Abo 🚀 und mache die Zukunft unseres unabhängigen Apple-Mediums aus der Schweiz mit möglich.

macprime unterstützen

Quellen

Über 200 Rekrutierungs-Bestrebungen von Apple in der Schweiz während den vergangenen vier Jahren; Gespräche mit mehreren involvierten Personen; Apple Machine Learning Research; macprime-Archiv, Apple Developer Documentation

Kommentare

Anmelden um neue Kommentare zu verfassen

Allegra Leser! Nur angemeldete Nutzer können bei diesem Inhalt Kommentare hinterlassen. Jetzt kostenlos registrieren oder mit bestehendem Benutzerprofil anmelden.